«ИИ-зима» близко? Искусственный интеллект подвержен опасным решениям — что нас ждет в будущем

Журналист The New York Times, Wired и издания Coders Клайв Томпсон в своем блоге на Medium спрашивает: «Зима близко? Конечно, я имею в виду “ИИ-зиму”».

Томпсон отмечает: зима — часть цикла развития искусственного интеллекта. Когда начинается бум ИИ, разработчики и компании представляют новые технологии, которые кажутся мощными и многообещающими. Технические компании используют их для создания продуктов, обещающих облегчить жизнь, инвесторы начинают вкладывать в это деньги.

Все, включая журналистов, охотящихся за новинками, начинают восторженно воспевать ИИ: «совсем как человек», «божественно», «знает все».

Но автор убежден: такой ажиотаж имеет свою цену. В какой-то момент ИИ оказывается не способным выполнить все обещания своих создателей.

Компании и люди, которые пытаются использовать его для решения повседневных проблем, обнаруживают, что он часто ошибается.

Затем начинается «ИИ-зима». Клиенты начинают думать, что цена на ИИ-продукты завышена, инвесторы не так охотно дают деньги, а в печати появляются критические статьи.

Интерес к ИИ уменьшается и поэтому даже изобретатели, придумавшие что-то действительно стоящее, не могут получить финансирование. Это длится годами.

Передаем слово автору.

«ИИ-зима» уже была. Дважды

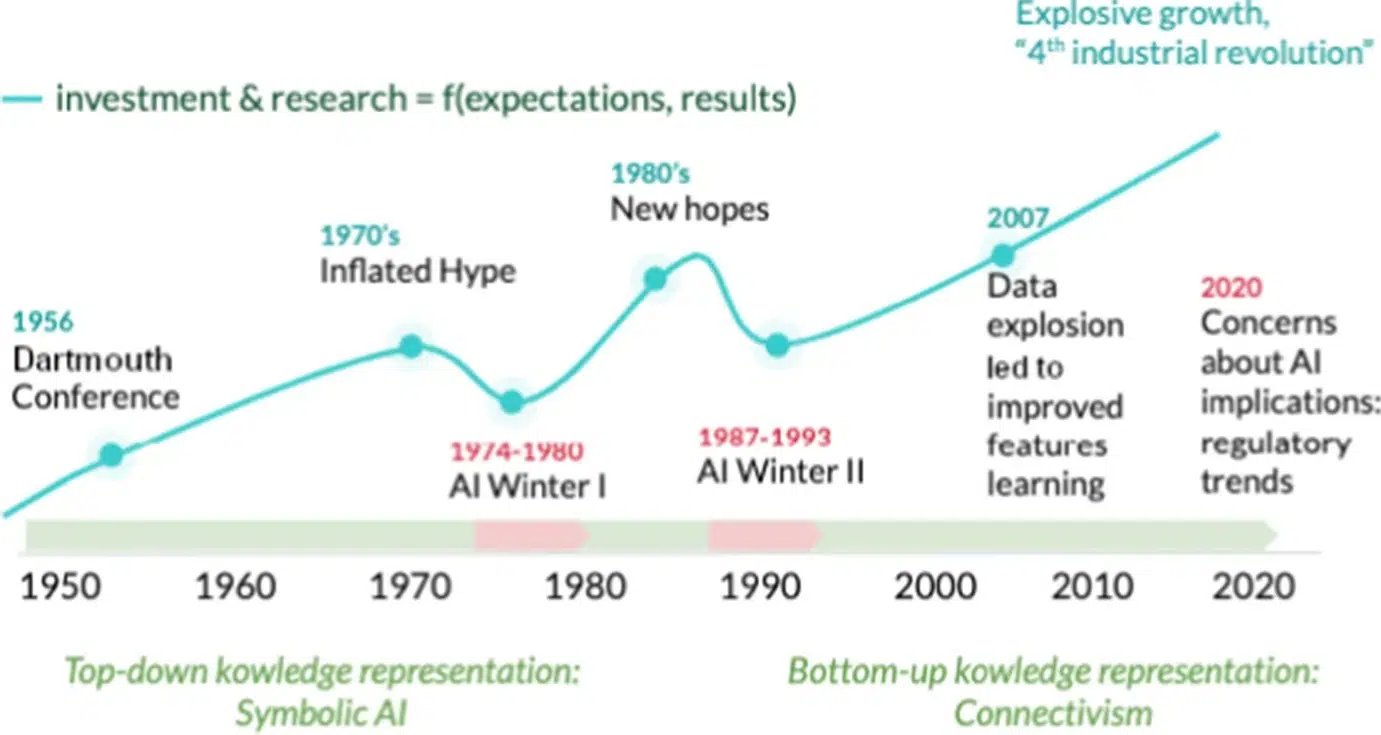

Уже были даже две большие «ИИ-зимы»:

На конференции в Дартмуте в 1956 году ученые предусмотрели, что «каждый аспект обучения или любая другая особенность интеллекта может быть настолько точно описана, что можно создать симулирующую это машину».

Два следующих десятилетия работе над ИИ сопровождали увлекательные обещания: когда New York Times впервые сообщил о нейронных сетях, репортер писал о «зародке электронного компьютера, который, как ожидают эксперты Navy, сможет ходить, говорить, видеть, писать, воспроизводить себя и осознавать собственное существование».

В то время разработчиков и компании особенно заинтересовала идея автоматического перевода текста: если бы это удалось, то прибыль измерялась бы миллиардами.

Но уже в начале 70-х годов стало ясно, что прототипы ранней стадии искусственного интеллекта не достигают обещанных результатов. Когда они делали машинный перевод, то не могли справиться даже с грамматикой средней сложности. Машины, которые учатся самостоятельно, все еще оставались научной фантастикой. Тогда и наступила «ИИ-зима»: инвесторы сбежали, денежные потоки иссякли.

Вдруг пришла «весна»

«Весна» пришла только в 80-х. К тому времени большинство технологических компаний отказались от сладких мечтаний создать самообучающуюся машину и сосредоточились на создании «экспертных систем».

В большинстве своем это были просто if-then — самые простые решения, которые пытались автоматизировать принятие решений по одной (и только одной) конкретной проблеме.

Visa собиралась создавать систему для автоматического одобрения заявок на кредитные карты; авиакомпания планировала получить автоматическую прокладку маршрута для самолетов.

Эти системы имели одно преимущество: они действительно работали. Но они были дорогими и могли использоваться только для конкретной задачи. А еще они ошибались, когда сталкивались с непредвиденными граничными случаями.

Я слышал о случае, когда такая система выдала кредитную карту девятилетнему ребенку, поскольку в заявке (конечно же, с ложными данными) было указано 20 лет опыта работы. Программисты забыли установить проверку для случая, когда опыт работы больше, чем возраст заказчика.

Вот это и было проблемой: реальный мир слишком сложен, чтобы охватить все. Когда о таких сбоях «экспертных систем» стали говорить все чаще, наступила очередная «ИИ-зима».

В мире продолжается «лето ИИ»

Заинтересованность ИИ снова достигла пика: происходящее в мире — это «лето ИИ».

В 2010-х годах появились хорошие результаты глубокого обучения.

Нейронные сети существовали десятилетиями, но в 90-е и начале 2000-х годов они считались непрактичными: для их обучения было недостаточно данных, и оно требовало слишком много ресурсов.

«Еще в 90-х люди смеялись над нами и говорили, что это никогда не сработает», — рассказывал мне пионер глубокого обучения Джефф Хинтон.

Но он и несколько его коллег, работавших в разных уголках мира, справились с этим. В 2000-х ситуация улучшилась. Количество тренировочных данных значительно увеличилось (поскольку люди публиковали в интернете множество фотографий и текстов). Обработка стала дешевой и быстрой.

Используя несколько хороших идей разработки нейронной сети от Хинтона и других пионеров, разработчики смогли улучшить распознавание образов в 2010-х годах.

Учась на множестве разногласий, нейронная сеть может стать мастером распознавания объектов, а обучение на парах переведенных предложений значительно улучшает ее способность как переводчика.

А если ИИ тренировать на текстах, будем иметь дело с GPT-3. Этот бот может настолько четко предсказать следующее возможное слово в предложении, что легко пишет прозу как человек, отвечает на вопросы и подытоживает документы.

Тренируете нейронную сеть на искусстве? Что ж, вы получите Midjourney. А если она училась на компьютерном коде — Copilot.

Инвесторы охотно дают деньги на ИИ, и стартапы запускают множество продуктов, работающих с генерацией текста или изображений или с дополнением кода.

Я только что проверил Product Hunt, там полно таких товаров. Вот три:

История повторяется: ИИ продолжает допускать ошибки

Может ли прийти новая «ИИ-зима»? Вот почему я начал об этом думать: некоторые исторические модели, кажется, повторяются.

Во-первых, мы увидели, что ИИ ошибается. Недавно Google продемонстрировал искусственный интеллект в чате (отчаянно пытаясь догнать OpenAI), и чат-бот допустил огромные фактические ошибки:

Не хочу быть ~ ну, на самом деле ~ придурком, и я уверен, что Бард будет впечатляющим, но для протокола: JWST не сделал «самое первое изображение планеты за пределами нашей Солнечной системы».

вместо этого первое изображение было сделано Chauvin et al. (2004) с VLT/NACO с использованием адаптивной оптики. https://t.co/bSBb5TOeUW pic.twitter.com/KnrZ1SSz7h

— Грант Тремблей (@astrogrant) 7 февраля 2023 г.

Фондовый рынок сразу снизил стоимость Google на $100 миллиардов, а это падение на 7,8%. Затем Microsoft представила свой новый продукт Bing, дополненный ChatGPT и он также допускал значительное количество фактических ошибок (в частности, настаивал, что сейчас все еще 2022 год).

Впрочем, многие (включая меня) не удивляются таким ситуациям: предсказание слов — мощная техника, но, как подозревают специалисты, этого может быть недостаточно, чтобы воспроизвести человеческое мышление.

Сбои происходят не только у языковых моделей: беспилотные автомобили тоже не идеальны. Национальная администрация по безопасности дорожного движения объявила об отзыве Tesla, оснащенных бета-версией Full Self-Driving Beta (программным обеспечением, предназначенным для автоматизации вождения).

По словам правительства, программное обеспечение Tesla создает «необоснованный риск для безопасности транспортных средств из-за недостаточного соблюдения законов безопасности дорожного движения», то есть оно подвержено непредсказуемым и опасным решениям.

Это может быть признаком приближения «ИИ-зимы». Также мы видим много обещаний, которые так и не выполнены.

Вспомните беспилотные автомобили: изобретатели говорили, что они вот-вот появятся («это индустрия на триллионы долларов», как сказал мне один компьютерный ученый в 2017 году), репортеры активно рассуждали об их потенциальном влиянии.

Пионеры языковых моделей настаивали, что если продолжать развивать такие модели и присылать им больше данных, они превратятся в осознающие себя машины (один из основателей OpenAI даже заявил, что GPT-3 уже «немного сознательный».) Такие амбициозные обещания создателей очень контрастируют с реальностью, когда ИИ не может сказать, какой сейчас год и раздражается, если его исправляют.

Вместо вывода

Но я уклонюсь от прямого ответа, что я думаю о будущем ИИ. Если честно, я не знаю, действительно ли «ИИ-зима» близко.

Даже если сегодняшние чат-боты окажутся мыльным пузырем, глубокое обучение как технология будет оставаться чрезвычайно ценной в узких сферах. Она показывает отличные результаты для создания автоматических опознавателей и категоризаторов. И она будет оставаться востребованной, даже если OpenAI так и не заставит ChatGPT отлично выполнять математические задачи для средней школы. Поэтому маловероятно, что отрасль ИИ придет в упадок.

Но это не точно. Может случиться так, что люди охотно будут баловаться с языковыми моделями («напиши мне шекспировский сонет о теории плоской Земли!»), но остерегаться использовать их для бизнеса. Или поток SEO-оптимизированной чепухи в интернете может привести к ухудшению репутации ИИ. Конечно, это будет влиять на заинтересованность инвесторов.

Или те же беспилотные автомобили: несмотря на то, что инвесторы вложили десятки миллиардов в эту сферу, на дорогах практически нет таких машин, а стартапы в этой индустрии, вышедшие в прошлом году на IPO, за два года потеряли 81% своей стоимости.

А еще можно вспомнить судебные иски против ИИ, создающего изображение и код: в них утверждается, что создатели ИИ не имели права использовать работы художников и чужой код для обучения.

Но я все-таки придерживаюсь мнения, что даже серьезный сбой не будет означать конец ИИ. Эта отрасль уже дважды переживала упадок и восстанавливалась. Если окажется, что большие языковые модели в том виде, в каком они созданы сейчас, обречены на ошибки и необоснованность, специалисты сосредоточятся на других технологиях.

С ИИ никогда не нужно говорить «никогда». Но если наступает зима и дорогу засыпает снегом — единственным вариантом развития может стать смена курса.

Автор: Клайв Томпсон

Текст адаптировала Евгения Козловская

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: